L’immersion dans les environnements de réalité étendue (XR) ne se limite plus au seul aspect visuel. Pour enrichir l’expérience utilisateur et la rendre plus naturelle, nous explorons aujourd’hui plusieurs modalités sensorielles : la vision, l’audio, l’haptique, et même l’olfactif. Si l’ambition est claire, sa mise en œuvre reste néanmoins semée d’embûches.

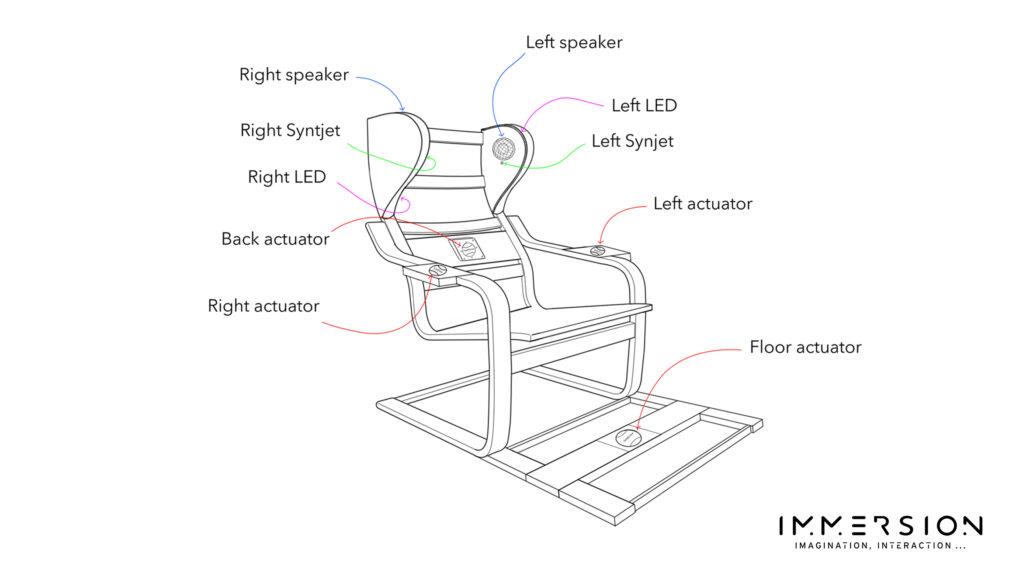

Dans le cadre du projet de recherche HEAT, Immersion a réalisé un pré-pilote d’un nouveau dispositif multisensoriel.

Une expérience immersive multimodale

Dans une expérience multimodale, chaque modalité sensorielle doit être non seulement convaincante individuellement, mais aussi parfaitement cohérente avec l’ensemble du dispositif. Un rendu haptique mal synchronisé avec le visuel, un décalage entre une source sonore spatialisée et sa position réelle, ou encore une odeur en inadéquation avec le contexte narratif risquent de briser l’illusion et de provoquer une dissonance cognitive chez l’utilisateur.

Cette exigence de synchronisation impose une gestion rigoureuse du temps réel, d’autant plus complexe lorsque l’on combine des modalités aux dynamiques très différentes. Alors que l’image et le son s’adaptent à des fréquences de rafraîchissement élevées, la restitution haptique et olfactive est soumise à des contraintes physiques plus lentes, rendant leur modulation dynamique plus difficile.

Chaque modalité repose sur des technologies aux niveaux de maturité et aux standards variés. Si les moteurs de rendu graphique et audio bénéficient de décennies d’optimisation, le rendu haptique et olfactif reste expérimental, souvent limité à des solutions propriétaires et fragmentées.

Cette hétérogénéité soulève d’importants défis d’interopérabilité. Comment garantir une latence minimale et un rendu fluide lorsqu’il s’agit de combiner des moteurs 3D, des systèmes de spatialisation audio, des retours haptiques complexes et des diffuseurs olfactifs ? Comment concevoir des architectures logicielles robustes capables d’orchestrer ces multiples flux sans compromettre la performance et la stabilité des applications XR ?

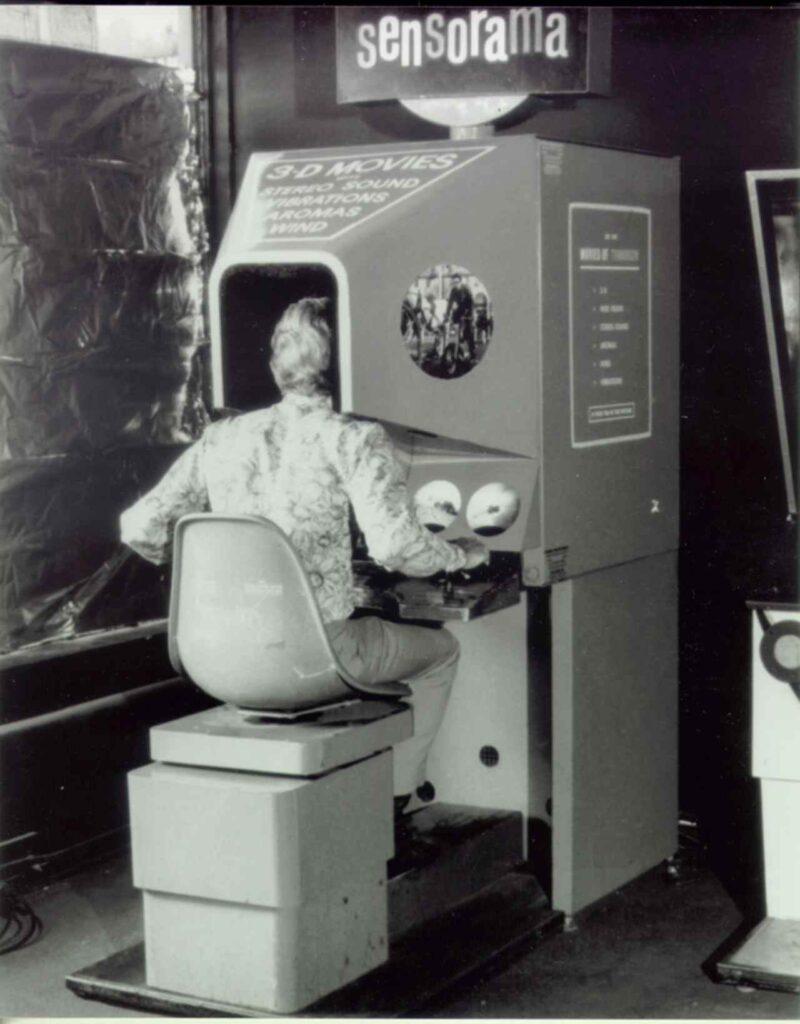

Pourquoi ce rapprochement avec la machine Sensorama ?

En 1962, bien avant l’essor de la réalité virtuelle, l’inventeur Morton Heilig développait le Sensorama, une machine immersive révolutionnaire visant à stimuler plusieurs sens simultanément.

Conçu comme l’un des premiers dispositifs de réalité étendue, le Sensorama offrait une expérience multisensorielle en combinant images 3D stéréoscopiques, son stéréo, vibrations, diffusion d’odeurs et flux d’air pour plonger l’utilisateur dans une simulation réaliste.

L’un des scénarios les plus marquants permettait, par exemple, de vivre une balade à moto dans les rues de New York, où l’on pouvait ressentir le vent sur son visage, les vibrations de la route et même les odeurs urbaines.

Malgré son avance technologique, le Sensorama n’a jamais connu de succès commercial en raison de son coût élevé et de son encombrement, dans un marché encore peu réceptif à ce type d’expérience immersive. Pourtant, il est aujourd’hui reconnu comme un précurseur des technologies de réalité virtuelle (VR) et de réalité étendue (XR), posant les bases des expériences immersives modernes.

Pour cette première expérimentation, la chaise multimodale du projet HEAT exploite trois dimensions sensorielles : le son, le vent et les vibrations, afin d’évaluer leur impact sur l’immersion.

Du prototype à l’adoption : quels enjeux pour demain ?

Au-delà des contraintes techniques, la multimodalité en XR requiert un véritable travail de design sensoriel. Il ne s’agit pas seulement d’ajouter des stimuli, mais de penser leur complémentarité et leur impact perceptif. Certaines combinaisons renforcent l’immersion, tandis que d’autres peuvent s’avérer contre-productives. Dans le cadre du projet HEAT, Immersion ambitionne d’explorer ces défis à travers trois cas d’usage : le e-learning, le théâtre et l’opéra. Pour ce premier pilote, les équipes ont développé un dispositif de test centré sur un élément potentiellement commun aux trois domaines : la chaise.

Une démonstration de ce prototype sera organisé dans le cadre de la conférence scientifique TEI dont Immersion est partenaire.

Envie de collaborer avec Immersion dans le cadre d’un projet de recherche ?Contactez-nous.